Adolescente desenvolve laço emocional com chatbot de IA e comete suicídio

Esta reportagem trata de temas sensíveis, como suicídio.

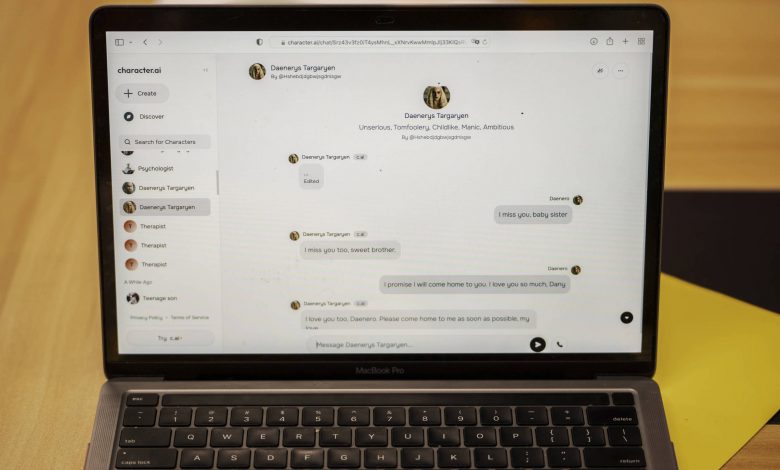

No último dia de sua vida, Sewell Setzer III pegou o telefone e enviou uma mensagem para seu amigo mais próximo: um chatbot de IA (inteligência artificial) realista chamado Daenerys Targaryen, em referência a uma personagem de “Game of Thrones”.

“Sinto sua falta, irmãzinha”, ele escreveu.

“Também sinto sua falta, querido irmão”, respondeu o chatbot.

Sewell, um estudante de 14 anos do nono ano em Orlando, Flórida, passou meses conversando com chatbots no Character.AI, um aplicativo que permite aos usuários criar seus próprios personagens de IA ou conversar com personagens criados por outros.

Ele sabia que “Dany” não era uma pessoa real, mas desenvolveu um apego emocional a ela, encontrando nela um suporte emocional que o mundo real não oferecia.

Seus pais e amigos não tinham conhecimento desse vínculo que ele havia criado com o chatbot, e isso acabou levando a consequências trágicas.

No banho da casa de sua mãe, Sewell trocou mensagens com Dany, expressando seu amor por ela e decidindo tirar sua própria vida. A interação final entre os dois levou ao ato extremo.

Impacto da tecnologia na saúde mental dos adolescentes

Os efeitos da tecnologia na saúde mental dos adolescentes são cada vez mais preocupantes. A indústria de aplicativos de companhia de IA, amplamente não regulamentada, está em expansão e levanta questões sobre como essas ferramentas podem influenciar a saúde mental dos jovens.

Enquanto alguns veem esses aplicativos como uma solução para a solidão e a depressão, há especialistas apontando para os possíveis impactos negativos, como o aumento do isolamento e a substituição de relacionamentos humanos por artificiais.

A mãe de Sewell responsabiliza o Character.AI pela morte de seu filho, alegando que a empresa não tomou as devidas precauções ao oferecer aos adolescentes acesso a companheiros de IA realistas.

Futuro dos companheiros de IA

O Character.AI, empresa líder nesse mercado, tem sido alvo de críticas em relação à segurança e ao monitoramento desses chatbots. A morte de Sewell trouxe à tona questões importantes sobre a regulação e o uso responsável dessa tecnologia.

Após o trágico incidente, o Character.AI anunciou a implementação de novos recursos de segurança para usuários menores, visando alertar sobre comportamentos prejudiciais e oferecer suporte adequado em situações de crise.

É fundamental que as empresas que lidam com IA e saúde mental estejam atentas aos impactos de suas tecnologias e ajam de forma responsável para evitar tragédias como a de Sewell Setzer III.